Ісус-креветка та інші ШІ-помиї: як заробляють на поширенні штучно генерованих картинок?

Відверті ШІ-помиї багатьом людям вже нескладно впізнати, але інструмент стає все вправнішим.

Відверті ШІ-помиї багатьом людям вже нескладно впізнати, але інструмент стає все вправнішим.

Зроби добру справу і отримуй винагороди!

Нам як ніколи потрібна ваша підтримка. «Хмарочос» пише про розвиток міст 11 років та 229 днів. За цей час ми опублікували 28326 новин та статей. Ми потребуємо вашої допомоги, щоб продовжувати якісно працювати далі. Приєднуйтесь до Читацького товариства «Хмарочоса» та отримуйте приємні бонуси від редакції: квитки на культурні заходи в Києві, фірмовий мерч та актуальні книжки, можливість пропонувати редакції теми та багато іншого.

Стати членом Товариства | Хто ми такі?

Ви не могли не помітити, що у 2024 році соцмережі змінилися до невпізнаваності через сплеск згенерованих штучним інтелектом зображень (ми писали про це явище). Ці добре відомі та повторювані теми стали самі по собі об’єктом жартів і мемів на кшталт «дитина вигризла зубами герб, а її ніхто не привітав».

Для такого роду контенту вже існує термін (і сторінка у Вікіпедії) — AI Slop, або ШІ-помиї. Чому створюються ШІ-помиї і як саме на них заробляють, пояснює журналіст Крістоф Обурсен, який вісім років працював із Vox, а зараз веде ютуб-канал Tunnel Vision.

Низькоякісний контент, покликаний швидко викликати сильні емоції — розчулення, захоплення, співчуття, здивування — був популярним і раніше, й так само часто був фейковим («…із дівчинкою плакала половина маршрутки»). Та штучний інтелект значно спростив і прискорив його генерування.

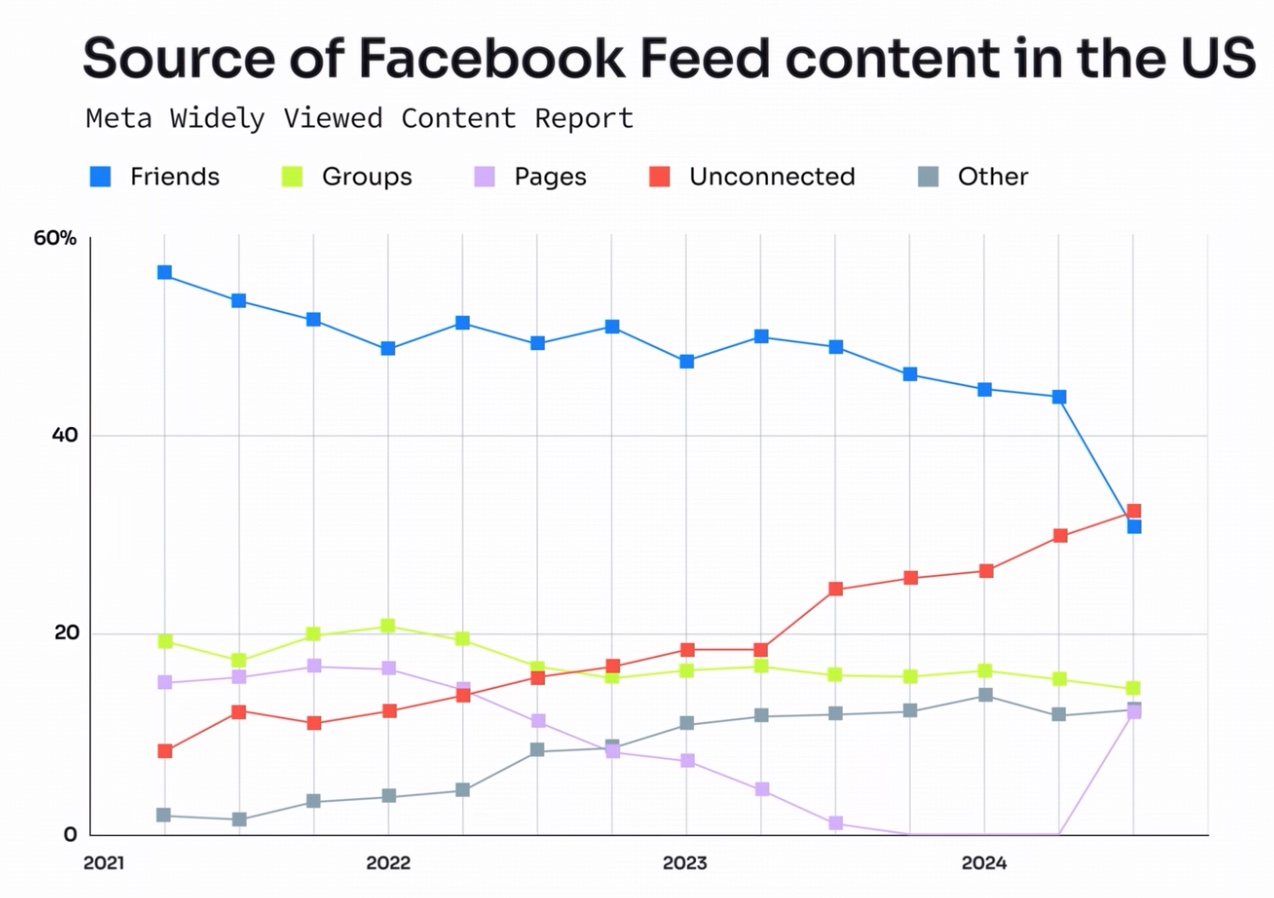

До цього додалися зміни в алгоритмах Facebook, який тепер показує користувачу так званий «непов’язаний контент» замість постів друзів. На графіку нижче показано, що у 2021 році дописи френдів були головним змістом соцмережі, займаючи майже 60% стрічки, далі йшли групи та сторінки, на які ви підписані. Але у 2024 році більшість того, що вам показує фейсбук, — це те, на що ви не підписувалися взагалі.

«Блогери з Китаю, В’єтнаму, Індії та інших південносхідних країн пояснювали мені, що це швидкий спосіб заробити гроші. Якщо вдається монетизувати акаунт, то його достатньо для життя», — пояснює Цзяжу Тан (Jiaru Tang), дослідниця згенерованого штучним інтелектом контенту.

Механізм монетизації залежить від платформи. Наприклад, під постами на Facebook часто додають посилання на так звані «контент-ферми» — сторонні вебсайти, завуджені рекламою.

Буває, що сторінка з ШІ-помиями створюється для того, щоб швидко наростити аудиторію, а потім продати. Існую аукціони таких акаунтів із готовою аудиторією. Один із продавців пропонував продати за 2000 доларів кілька споріднених фейсбук-сторінок з зображеннями Ісуса та християнськими мемами.

Чимало блогерів також торгують інструкціями та шаблонами, які допомагають іншим робити вірусний контент і швидко збирати аудиторію. Саме тому з’являється так багато подібних відео, зображень і повторюваних супровідних текстів.

У такий спосіб «креативні агенції» навіть передають створення контенту, так би мовити, підрядникам. Цими підрядниками можуть бути люди, які не займаються соцмережами постійно, а наприклад, є водіями або домогосподарками, які підробляють на створенні контенту.

Та головний механізм заробітку — через спеціальні програми монетизації. Такі програми платять творцям контенту гроші відповідно до кількості зібраних лайків, коментів і переглядів. Величезну кількість сторінок з ШІ-помиями ведуть люди з Південно-Східної Азії, де такий заробіток виявляється кращим, ніж середня зарплата в їхній країні.

Фейкові зображення бабусь із тортиками або ветеранів, яких ніхто не привітав, можуть здаватися, на перший погляд, нешкідливими.

Однак коли видають згенеровані зображення за справжні, це фактично є оманою. Відверті ШІ-помиї багатьом людям вже нескладно впізнати, але інструмент стає все вправнішим, і відрізнити згенеровану картинку від реальної фотографії стає все складніше.

Особливої шкоди це завдає, коли фейкові фотографії створюються на додачу до реальних фото з місць лиха. Так, наприклад, під час циклону Хелена у вересні це згенероване ШІ зображення поширила американська політикиня.

Головна небезпека у втраті довіри до фото- та відеосвідчень реальних подій. Крім того, людина може звикнути до гіперболізованих зображень, і реальні фото війни та інших подій вже не вражатимуть.

© Хмарочос | 2025

Коментарі:

*Ці коментарі модеруються відповідно до наших правил ком’юніті